Blog

Fairly AI募集170萬美元,致力於解決AI風險和合規難題:目標打造AI政策和控制市場

Fairly AI募集170萬美元,致力於解決AI風險和合規難題:目標打造AI政策和控制市場

September 20, 2023

重點摘要:

新聞內文:

David Van Bruwaene在康奈爾大學攻讀哲學博士學位時,對語言學和自然語言處理「NLP」產生了濃厚的興趣,NLP是AI的一個子領域,涉及使機器理解人類語言。在離開學術界後加入「VISR」,這是一家專注於「應用NLP來檢測社群媒體上的網路欺凌」的AI新創公司。Van Bruwaene表示,他最初體驗到了確保AI開發人員和業務決策者在整個AI開發過程中保持一致的挑戰。

Van Bruwaene在電子郵件訪談中告訴TechCrunch「有關AI監控的談話以無法想像的速度加快,『AI安全』幾乎是所有人都關心的問題」。「問題是,AI專案可能會無休止地進行,卻沒有明確的生產路線,因為沒有人可以確定AI是否足夠安全和合乎規定到可以投入生產」。

Fion Lee-Madan,她曾在「Sapient」、「Intuit」和「ATG」等公司擔任企業系統解決方案架構師。在與她見面後,Van Bruwaene說服她協助共同開發一個名為「Fairly AI」的平台,以協助組織管理其AI系統周圍的風險。

在大流行期間,Fairly AI在Accenture的「FinTech Innovation Lab」中誕生,並在今年初被Techstars加速器接受,成為一家正式的公司。

Fairly AI的CEO Van Bruwaene說:「Fairly使數據科學家和政策專家能夠透過對內部和第三方AI系統應用政策和控制來加速AI的採納,從而降低風險」。「Fairly的使命是實現AI的安全、安全和合規採納」。

Fairly旨在建立一個AI政策和控制的「市場」,其中包括合作夥伴的政策和控制,及包括合作夥伴關係AI和非營利性負責任AI研究所。正如Van Bruwaene所解釋的,Fairly從其他行業(主要是金融服務行業)提取框架和控管、風險和合規流程,並將其適用和擴展到AI。

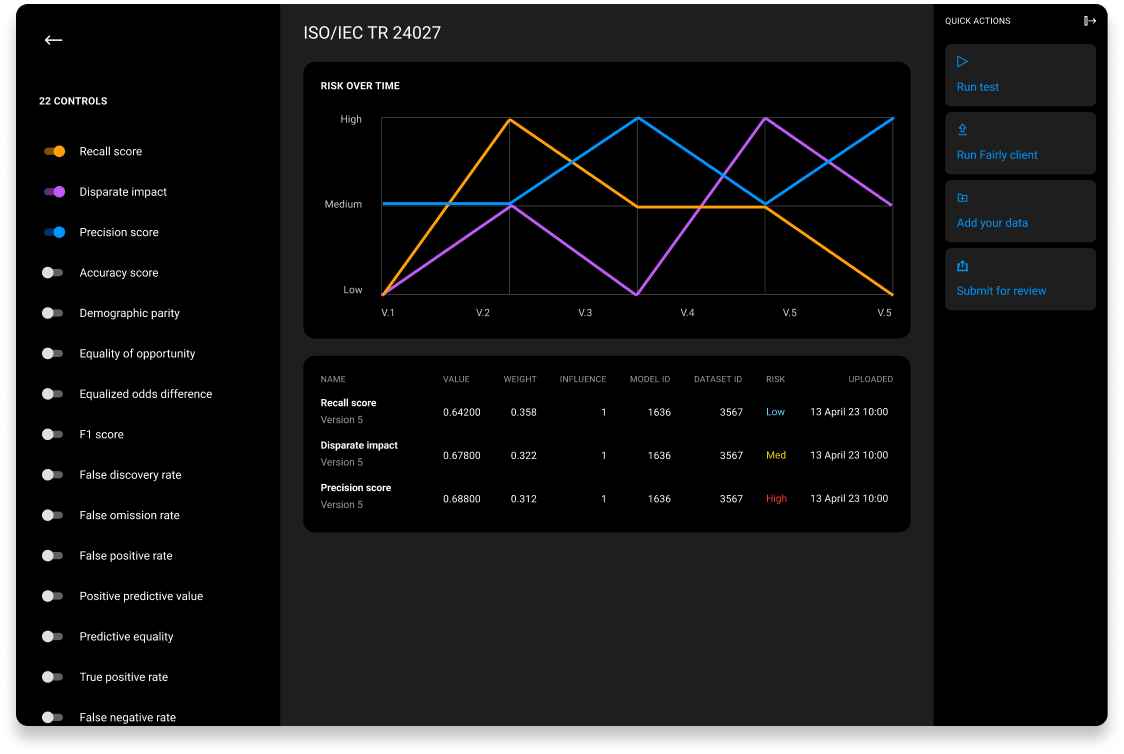

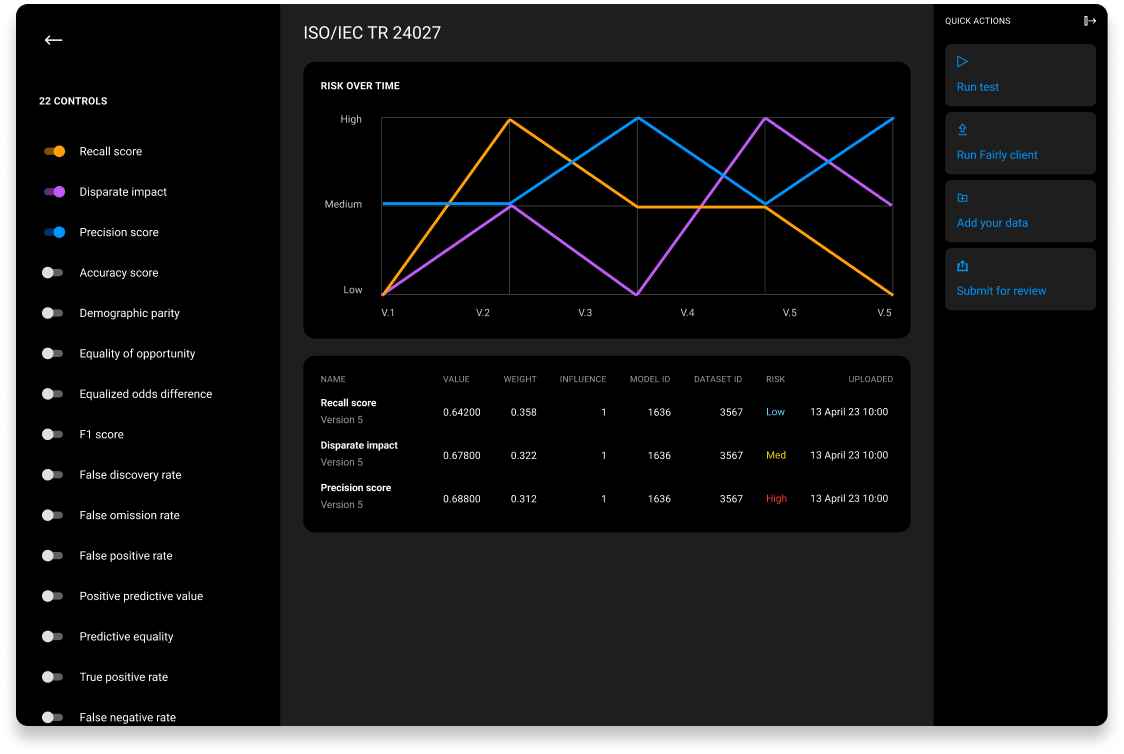

Fairly的平台部署在當地或私有雲端中,可以將公司的AI模型和數據集與內部和外部政策、相關標準和法規進行對比。該平台可以手動運行或連續運行,透過一行代碼與現有的CI/CD管道集成。

Van Bruwaene表示,目標是使普通人更容易理解可能與AI系統相關的風險和合規問題,並在新風險出現時加以減輕傷害。

他舉例說,Zillow Offers就是一個由於治理不足而出現問題的範例。2022年,由於該服務背後的算法未考慮到材料和人工成本的飆升,導致Zillow購買了成千上萬套房屋,迫使其關閉了Zillow Offers,該服務以僅需兩天的時間向房主提供現金購買他們的房產。

生成AI(例如ChatGPT)的出現進一步加劇了風險管理的困難。麥肯錫今年的一項調查發現,僅21%的人在工作中使用AI的人表示,他們的雇主已經規定了員工「應該如何使用AI」及「不應該如何使用AI」的政策。只有32%的人表示,他們的公司正在採取措施來減少來自AI的不準確資訊的風險,而38%的人表示,他們的組織正在採取措施應對相關的網路安全威脅。

Van Bruwaene表示:「我們Fairly的目標受眾告訴我們,他們不想看到現有的機器學習監測和可觀察性工具中常見的所有圖形和圖表,因為他們不理解它們」。 「我們的技術允許我們將合規要求轉化為工程要求,以為決策者提供『交通燈』信號」。

Fairly的推出正值AI行業的轉折點。政策制定者,特別是海外政策制定者,正在考慮標準化AI監控的方法,以防止部署AI可能帶來的危害。

歐盟正在制定AI法案,該法案旨在引入一個統一的AI系統監控和法律框架。去年,白宮發布了「AI權利法案」的構思概念,這是一份旨在指導如何設計和使用AI技術的建議性原則清單。中國對生成AI等AI藝術工具在網路上的部署方式實施了限制。

斯坦福大學2023年的AI指數顯示,2022年全球有37項與AI相關的法案已經成為法律。正如Van Bruwaene所指出的,對於使用AI的公司來說,這是一個需要關注的問題。

他說:「公司需要使用像Fairly這樣的工具來幫助建立政策和控制,以便AI開發人員知道目標位置。這最終是一個業務決策」。「透過提供真正的可解釋性,既包括定性控制,又包括定量控制,Fairly可以幫助加速合規過程」。

Fairly尚未實現收入,但Van Bruwaene聲稱該公司已經與四個不同國家的共同設計合作夥伴完成了「賺錢的」試點。他補充說:「我們已將我們的測試項目擴展到了十多個客戶,並正在與一些政府機構進行談判,其中至少有一個已經開始了試點」。

儘管AI風險和合規管理領域的參與者數量不斷增加,但市場研究公司Allied Market Research預計,到2032年,AI信任、風險和安全管理產品的市場將達到74億美元,而2022年則為17億美元。但Van Bruwaene對競爭不擔心,或者至少給人的印象是不擔心。

他說:「由於我們是在大流行期間開始的,所以我們從一開始就是一支遠程團隊」。「在加拿大,我們有科學研究和實驗發展信貸,因此我們的研發燒光率幾乎比我們的美國競爭對手低40%」。

為了支持客戶獲得,Fairly最近完成了由Flying Fish Partners領導的170萬美元種子輪,並獲得了Loyal VC、Backstage Capital、XFactor Ventures、NEXT Canada和Techstars Toronto的參與。Van Bruwaene表示,新資金的大部分將用於產品開發及建立市場團隊,並在未來一年間將Fairly的員工從12名員工和契約工擴展到24名員工」。

他補充說:「我們的平台確實試圖幫助組織了解其運營風險,模型風險和合規風險,以便他們可以做出明智的『進行與不進行』決策,並避免花費數百萬美元購買AI模型,卻陷入無休止的風險和合規審查周期」。

新聞原址: https://techcrunch.com/2023/09/19/fairly-ai-wants-to-help-companies-better-understand-their-ai-risk/

- 「Fairly AI」是一個新創公司,專注於幫助組織管理AI系統周圍的風險和合規問題。該平台由康奈爾大學哲學博士David Van Bruwaene和企業系統解決方案架構師Fion Lee-Madan共同開發。

- Fairly AI的平台可以與內部和外部政策、相關標準和法規進行對比,並可手動運行或連續運行。該公司已經完成了由Flying Fish Partners領導的170萬美元種子輪融資。

- 隨著AI的普及,AI的安全和合規性成為越來越多人關注的問題。Fairly AI旨在建立一個AI政策和控制的「市場」,並將其應用和擴展到AI領域。

新聞內文:

David Van Bruwaene在康奈爾大學攻讀哲學博士學位時,對語言學和自然語言處理「NLP」產生了濃厚的興趣,NLP是AI的一個子領域,涉及使機器理解人類語言。在離開學術界後加入「VISR」,這是一家專注於「應用NLP來檢測社群媒體上的網路欺凌」的AI新創公司。Van Bruwaene表示,他最初體驗到了確保AI開發人員和業務決策者在整個AI開發過程中保持一致的挑戰。

Van Bruwaene在電子郵件訪談中告訴TechCrunch「有關AI監控的談話以無法想像的速度加快,『AI安全』幾乎是所有人都關心的問題」。「問題是,AI專案可能會無休止地進行,卻沒有明確的生產路線,因為沒有人可以確定AI是否足夠安全和合乎規定到可以投入生產」。

Fion Lee-Madan,她曾在「Sapient」、「Intuit」和「ATG」等公司擔任企業系統解決方案架構師。在與她見面後,Van Bruwaene說服她協助共同開發一個名為「Fairly AI」的平台,以協助組織管理其AI系統周圍的風險。

在大流行期間,Fairly AI在Accenture的「FinTech Innovation Lab」中誕生,並在今年初被Techstars加速器接受,成為一家正式的公司。

Fairly AI的CEO Van Bruwaene說:「Fairly使數據科學家和政策專家能夠透過對內部和第三方AI系統應用政策和控制來加速AI的採納,從而降低風險」。「Fairly的使命是實現AI的安全、安全和合規採納」。

Fairly旨在建立一個AI政策和控制的「市場」,其中包括合作夥伴的政策和控制,及包括合作夥伴關係AI和非營利性負責任AI研究所。正如Van Bruwaene所解釋的,Fairly從其他行業(主要是金融服務行業)提取框架和控管、風險和合規流程,並將其適用和擴展到AI。

Fairly的平台部署在當地或私有雲端中,可以將公司的AI模型和數據集與內部和外部政策、相關標準和法規進行對比。該平台可以手動運行或連續運行,透過一行代碼與現有的CI/CD管道集成。

Van Bruwaene表示,目標是使普通人更容易理解可能與AI系統相關的風險和合規問題,並在新風險出現時加以減輕傷害。

他舉例說,Zillow Offers就是一個由於治理不足而出現問題的範例。2022年,由於該服務背後的算法未考慮到材料和人工成本的飆升,導致Zillow購買了成千上萬套房屋,迫使其關閉了Zillow Offers,該服務以僅需兩天的時間向房主提供現金購買他們的房產。

生成AI(例如ChatGPT)的出現進一步加劇了風險管理的困難。麥肯錫今年的一項調查發現,僅21%的人在工作中使用AI的人表示,他們的雇主已經規定了員工「應該如何使用AI」及「不應該如何使用AI」的政策。只有32%的人表示,他們的公司正在採取措施來減少來自AI的不準確資訊的風險,而38%的人表示,他們的組織正在採取措施應對相關的網路安全威脅。

Van Bruwaene表示:「我們Fairly的目標受眾告訴我們,他們不想看到現有的機器學習監測和可觀察性工具中常見的所有圖形和圖表,因為他們不理解它們」。 「我們的技術允許我們將合規要求轉化為工程要求,以為決策者提供『交通燈』信號」。

Fairly的推出正值AI行業的轉折點。政策制定者,特別是海外政策制定者,正在考慮標準化AI監控的方法,以防止部署AI可能帶來的危害。

歐盟正在制定AI法案,該法案旨在引入一個統一的AI系統監控和法律框架。去年,白宮發布了「AI權利法案」的構思概念,這是一份旨在指導如何設計和使用AI技術的建議性原則清單。中國對生成AI等AI藝術工具在網路上的部署方式實施了限制。

斯坦福大學2023年的AI指數顯示,2022年全球有37項與AI相關的法案已經成為法律。正如Van Bruwaene所指出的,對於使用AI的公司來說,這是一個需要關注的問題。

他說:「公司需要使用像Fairly這樣的工具來幫助建立政策和控制,以便AI開發人員知道目標位置。這最終是一個業務決策」。「透過提供真正的可解釋性,既包括定性控制,又包括定量控制,Fairly可以幫助加速合規過程」。

Fairly尚未實現收入,但Van Bruwaene聲稱該公司已經與四個不同國家的共同設計合作夥伴完成了「賺錢的」試點。他補充說:「我們已將我們的測試項目擴展到了十多個客戶,並正在與一些政府機構進行談判,其中至少有一個已經開始了試點」。

儘管AI風險和合規管理領域的參與者數量不斷增加,但市場研究公司Allied Market Research預計,到2032年,AI信任、風險和安全管理產品的市場將達到74億美元,而2022年則為17億美元。但Van Bruwaene對競爭不擔心,或者至少給人的印象是不擔心。

他說:「由於我們是在大流行期間開始的,所以我們從一開始就是一支遠程團隊」。「在加拿大,我們有科學研究和實驗發展信貸,因此我們的研發燒光率幾乎比我們的美國競爭對手低40%」。

為了支持客戶獲得,Fairly最近完成了由Flying Fish Partners領導的170萬美元種子輪,並獲得了Loyal VC、Backstage Capital、XFactor Ventures、NEXT Canada和Techstars Toronto的參與。Van Bruwaene表示,新資金的大部分將用於產品開發及建立市場團隊,並在未來一年間將Fairly的員工從12名員工和契約工擴展到24名員工」。

他補充說:「我們的平台確實試圖幫助組織了解其運營風險,模型風險和合規風險,以便他們可以做出明智的『進行與不進行』決策,並避免花費數百萬美元購買AI模型,卻陷入無休止的風險和合規審查周期」。

新聞原址: https://techcrunch.com/2023/09/19/fairly-ai-wants-to-help-companies-better-understand-their-ai-risk/