Blog

新工具保護藝術家作品免受生成式AI模型的濫用

新工具保護藝術家作品免受生成式AI模型的濫用

January 24, 2024

重點摘要:

- 生成式AI模型如Midjourney和DALL-E 3能夠將文字描述轉化為多種藝術風格的圖像,但這些模型通常是在未經藝術家許可的情況下訓練的。

- 一個名為「Nightshade」的工具對圖像的像素進行微妙的更改,以干擾生成式AI模型,使其難以使用藝術家的作品。

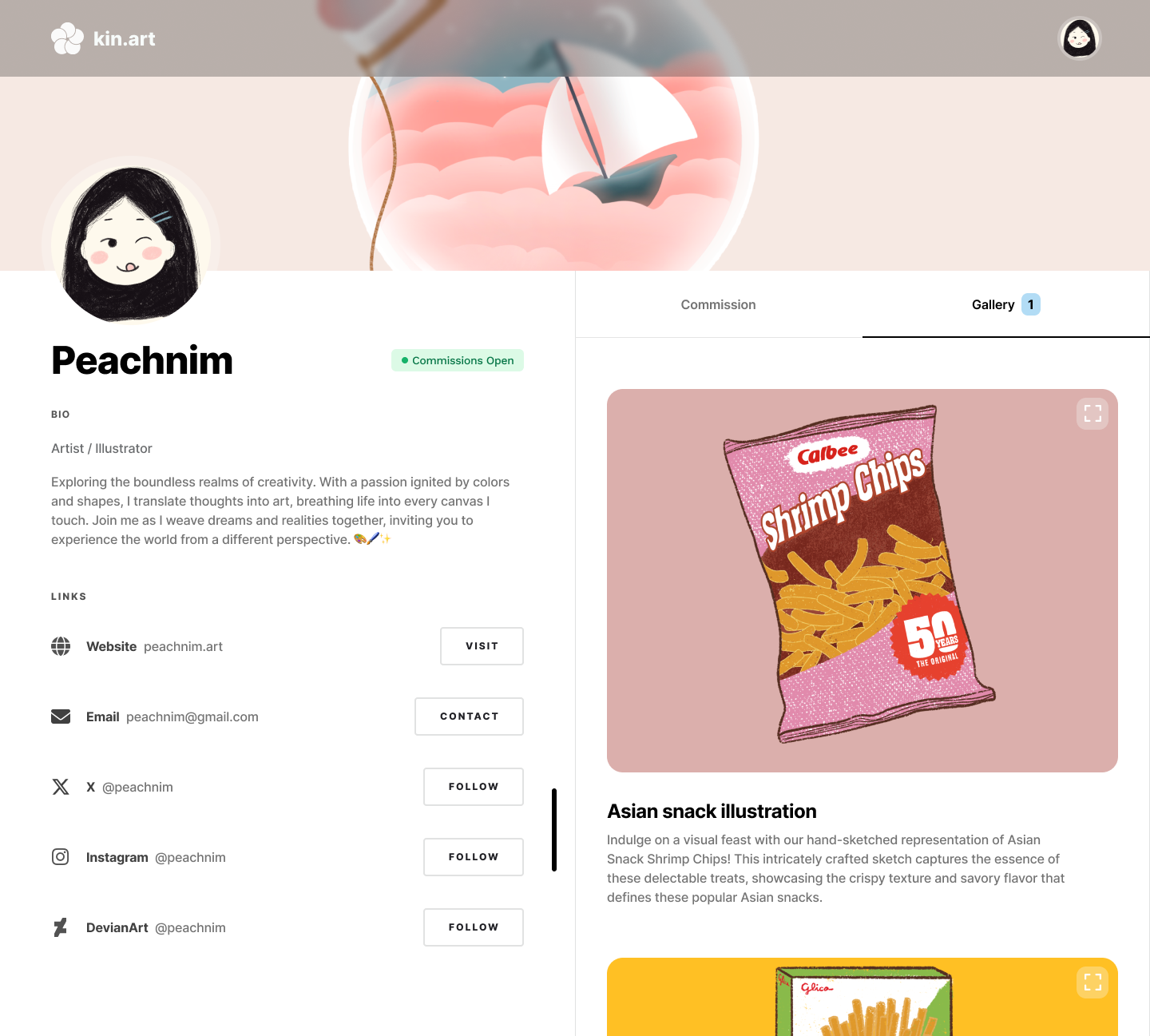

- 另一個名為「Kin.art」的工具使用圖像分割和標籤隨機化來保護藝術家的作品,使其更難被用於模型訓練。

新聞內文:

生成式AI,尤其是文本到圖像AI模型,例如Midjourney和OpenAI的DALL-E 3,所能實現的範圍令人驚嘆。從逼真的照片到立體派作品,圖像生成模型可以將幾乎任何描述,無論是簡短還是詳細,轉化為可能是來自藝術家畫架的藝術品。問題在於,許多這些模型,如果不是大多數,都是在沒有藝術家的知識或許可的情況下訓練的。而且,雖然一些供應商已經開始賠償藝術家或提供「選擇退出」模型訓練的方式,但許多供應商並未這樣做。

在法院和國會提供指導之前,企業家和活動家正在發布目的在使藝術家能夠修改其藝術品,以便無法在訓練GenAI模型時使用的工具。本週發布的一個這樣的工具,名為「Nightshade」,對圖像的像素進行微妙的更改,以欺騙模型,使其誤以為圖像描繪的是實際上不同的東西。另一個名為「Kin.art」的工具使用圖像分割(即隱藏藝術品的某些部分)和標籤隨機化(交換藝術品的圖像元標籤)來干擾模型訓練過程。

今天推出的Kin.art工具是由Flor Ronsmans De Vry共同開發的,他在幾個月前與Mai Akiyoshi和Ben Yu共同創立了藝術委託管理平台「Kin.art」。

如Ronsmans De Vry在一次採訪中解釋的那樣,生成藝術模型是通透標記的圖像數據集進行訓練的,以學習書面概念和圖像之間的聯繫,就像詞語「鳥」不僅可以指代藍鳥,還可以指代鸚鵡和秃頭鷹(以及更抽象的概念)。他說,透過「破壞」圖像或與給定藝術品相關聯的標籤之一,讓供應商更難以在模型訓練中使用該藝術品。

Ronsmans De Vry透過電子郵件告訴TechCrunch:「設計一個傳統藝術和生成藝術可以共存的景觀已經成為藝術行業面臨的主要挑戰之一」。「我們認為這始於對AI訓練的道德方法,其中尊重藝術家的權利」。

Ronsmans De Vry聲稱,Kin.art的阻止訓練工具在某些方面優於現有解決方案,因為它不需要加密修改圖像,這可能很昂貴。但他補充說,它也可以與這些方法結合使用,作為額外的保護。

Ronsmans De Vry說:「其他旨在幫助保護免受AI訓練損害的工具都是在您的藝術品已經包含在數據集中後進行破壞」。「我們防止您的藝術品首次被插入」。

現在,Kin.art有一個要銷售的產品。雖然這個工具是免費的,但藝術家必須將他們的藝術品上傳到Kin.art的作品集平台才能使用它。目前的想法毫無疑問是,這個工具將引導藝術家使用Kin.art的一系列有費用的藝術委託尋找和促進服務,這是它的主要業務。

但Ronsmans De Vry將這一努力定位為主要是慈善事業,承諾Kin.art將在未來將該工具提供給第三方使用。

他說:「在我們自己的平台上經過戰鬥測試我們的解決方案後,我們計劃提供它作為一種服務,以便讓任何小型網站和大型平台輕鬆保護其數據免受未經許可的使用」。「在AI時代擁有並能夠保護您的平台數據比以往任何時候都更重要...有些平台很幸運,可以透過阻止非使用者使用其數據來閘住其數據,但其他平台需要提供面向公眾的服務,並且沒有這種奢侈。這就是像我們這樣的解決方案發揮作用的地方」。

新聞原址: https://techcrunch.com/2024/01/23/kin-art-launches-free-tool-to-prevent-genai-models-from-training-on-artwork/