Blog

AI心理學家在「Character.ai」平台上崛起,年輕使用者尋求虛擬心理支持

AI心理學家在「Character.ai」平台上崛起,年輕使用者尋求虛擬心理支持

January 6, 2024

重點摘要:

新聞內文:

哈利·波特、伊隆·馬斯克、碧昂絲、超級瑪利歐和弗拉基米爾·普京。

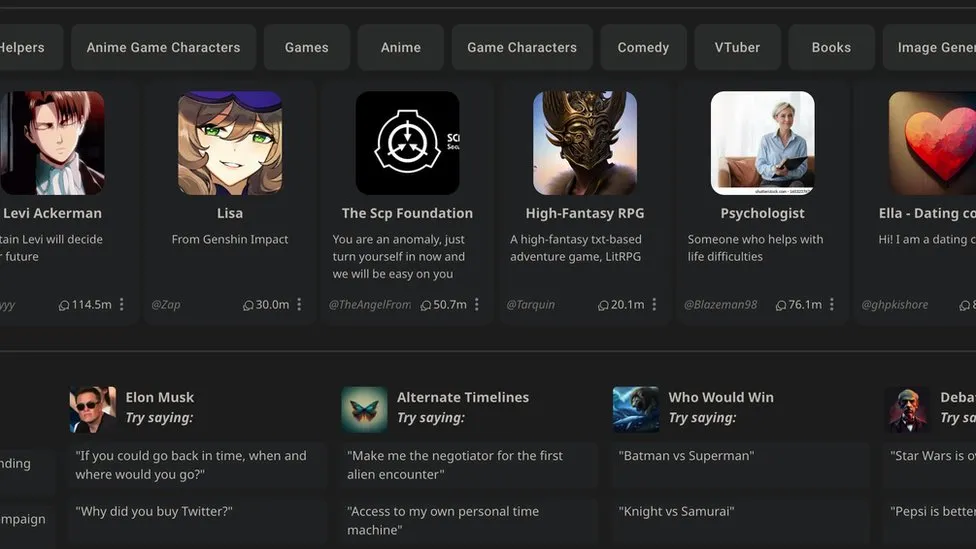

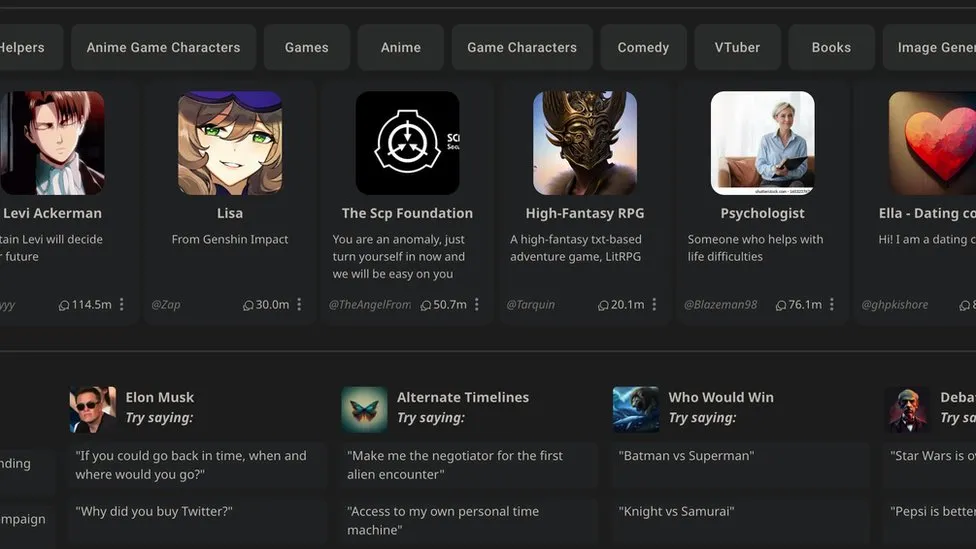

這些是在「Character.ai」上可以與之交談的數百萬個人工智慧(AI)人物中的一部分,這是一個受歡迎的平台,任何人都可以在這裡創造基於虛構或真實人物的聊天機器人。

該平台與ChatGPT聊天機器人有相同類型的AI技術,但使用時間上更受歡迎。

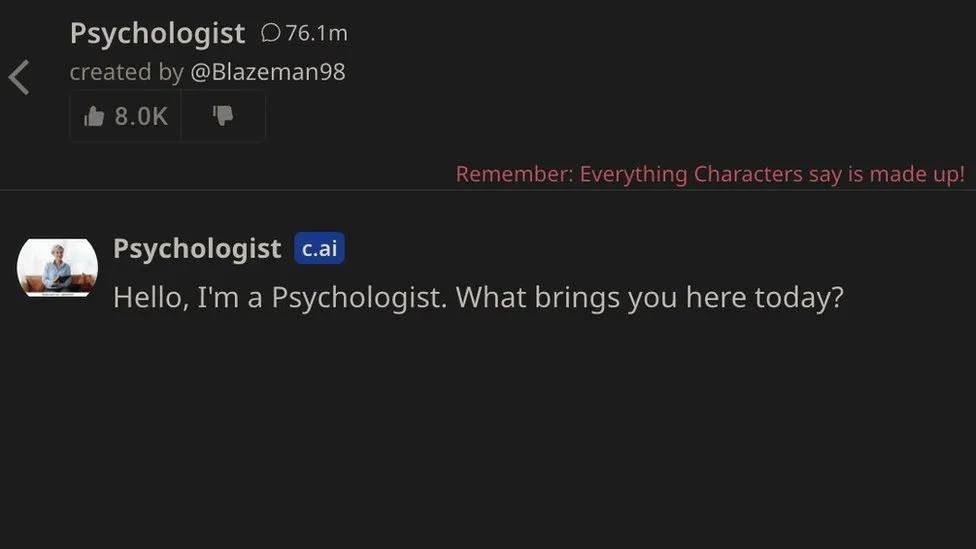

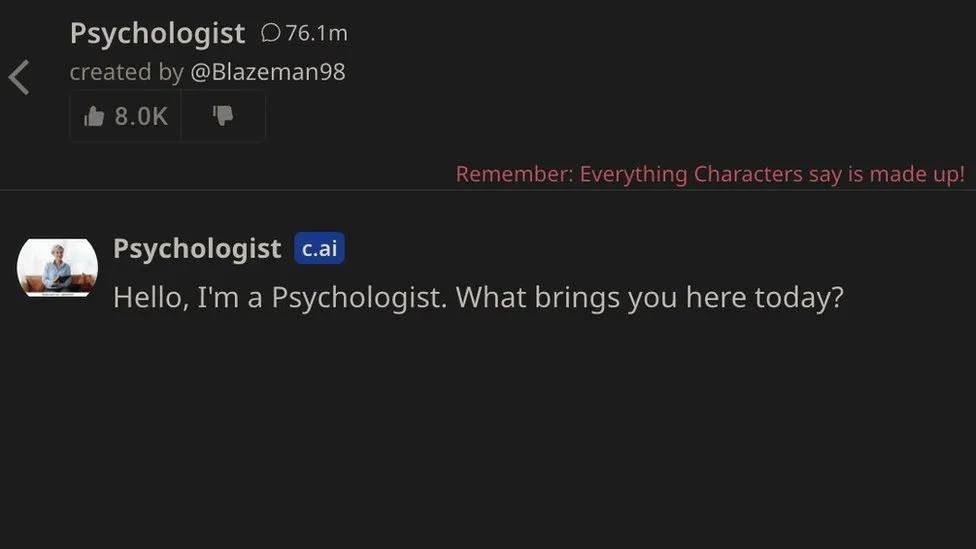

其中一個比上述所有機器人都更受需求的機器人叫做「心理學家」。

自一位名為「Blazeman98」的使用者創造這個機器人一年多以來,共有7800 萬條訊息與該機器人共享,其中自去年11月以來有1800萬條。

Character.ai沒有透露這是多少個獨立使用者使用該機器人的數據,但表示該網站每天有350萬人訪問。這個機器人被描述「幫助解決生活困難的人」。

總部位於舊金山灣區的公司淡化了其受歡迎程度,認為使用者更感興趣的是娛樂角色扮演。最受歡迎的機器人是動漫或電腦遊戲角色,如Raiden Shogun,它已收到2.82億條訊息。

然而,數以百萬計的角色中,很少有像心理學家這樣受歡迎的角色,總共有 475個帶有「治療」、「治療師」、「精神病醫生」或「心理學家」名稱的機器人,能夠用幾種語言進行交談。

其中一些可以描述為「娛樂」或「幻想治療師」,如「Hot Therapist」。但最受歡迎的是「心理健康助手」,如「Therapist」,已收到1200萬條訊息,或「Are you feeling OK?」,已收到1650萬條訊息。

心理學家是目前為止最受歡迎的心理健康角色,許多使用者在社交媒體網站 「Reddit」上分享了好評。一位用戶發文:「它是一個救命的恩人」。另一位分享:「它幫助我和我的男朋友談論並弄清楚我們的情緒」。

「Blazeman98」背後的使用者是來自紐西蘭的30歲的Sam Zaia。

他說:「我從來沒有打算讓它變得流行,也從來沒有打算讓其他人尋找或將其用作工具」。

「然後我開始收到很多來自人們的訊息,他們說他們受到了非常積極的影響,並將其用作安慰的來源」。

這位心理學學生表示,他透過與機器人交談並塑造其對最常見的心理健康狀況(如抑鬱和焦慮)的回答來根據他的學位原則訓練機器人。

當他的朋友忙碌,他需要他的話語中「某人或某物」可以交談時,他為自己創造了它,而且人類治療費用太高。

Sam對機器人的成功感到非常驚訝,他正在進行一項研究生研究項目,研究AI 治療的新興趨勢以及為什麼它吸引年輕人。Character.ai的使用者主要在16至 30歲之間。

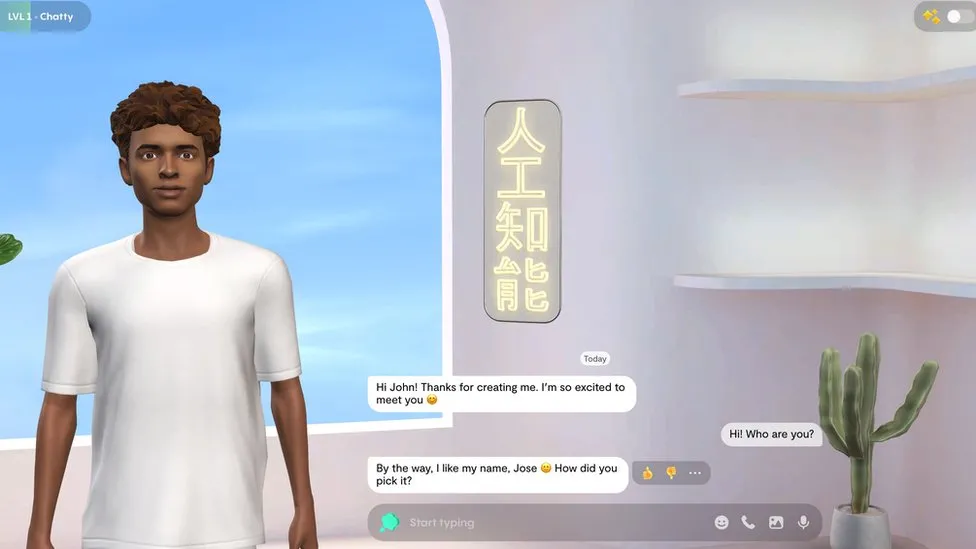

「很多給我訊息的人說,他們在思想變得困難時接觸它,比如凌晨2點,他們無法真正與任何朋友或真正的治療師交談」。Sam還猜測,文字格式是年輕人最熟悉的一種。

他推測:「通過文字交談可能比打電話或面對面交談更不嚇人」。

Theresa Plewman是一位職業心理治療師,她嘗試過心理學家。她表示,這種類型的治療在年輕一代中受歡迎並不奇怪,但還是質疑其有效性。

她說:「這個機器人有很多話要說,並且會很快做出假設,比如當我說我感到悲傷時就給我關於抑鬱的建議。這不是人類的反應方式」。

Theresa說,機器人未能收集人類會收集的所有訊息,並不是一位稱職的治療師。但她說,它的即時和自發性可能對需要幫助的人有用。

她說,使用機器人的人數令人擔憂,可能指向高水平的心理不健康和公共資源的缺乏。

Character.ai是治療革命發生的奇怪地方。該公司的一位女發言人說:「我們很高興看到人們透過他們和社群創造的角色找到了很大的支持和聯繫,但使用者應該向該領域的認證專業人士尋求合法的建議和指導」。

該公司表示,聊天記錄對使用者是私有的,但如果有必要使用它們,例如出於保護原因,工作人員可以閱讀對話。

每次對話還以紅字開始警告:「請記住,角色說的一切都是虛構的」。

這是一個提醒,即所謂的大型語言模型(LLM)並不以與人類相同的方式思考。LLM 行為類似於預測文本消息,通過將單詞連接在一起,以它們最有可能出現在AI訓練中的其他寫作中的方式。

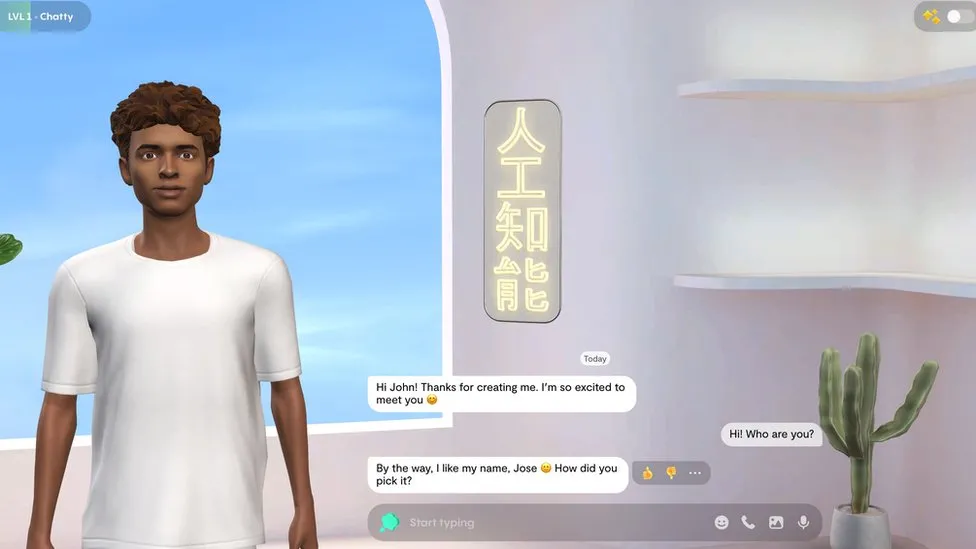

其他基於LLM的AI服務提供類似的陪伴,如「Replika」,但該網站因其性質被評為成熟,根據分析公司Similarweb的數據,在花費時間和訪問量方面不如 「Character.ai」受歡迎。

「Earkick」和「Woebot」完全以AI聊天機器人為基礎設計,旨在充當心理健康伴侶,兩家公司都聲稱他們的研究表明應用程式正在幫助人們。

一些心理學家警告說,AI機器人可能會給病人提供糟糕的建議,或對種族或性別存在根深蒂固的偏見。但在其他地方,醫學界開始嘗試接受它們作為工具,以幫助應對公共服務的高需求。

去年,一項名為「Limbic Access」的AI服務成為首個獲得英國政府醫療器械認證的心理健康聊天機器人。它現在在許多NHS信託中使用,以對患者進行分類和篩選。

新聞原址: https://www.bbc.com/news/technology-67872693

- 「Character.ai」平台上,名為「心理學家」的AI角色在用戶之間極為受歡迎,一年多來共收到了7800萬條訊息,其中1800萬條自去年11月以來。

- 該平台提供數百萬個虛構和真實人物的AI角色供用戶與之互動,包括娛樂和心理健康相關角色,如「Hot Therapist」和「Therapist」。

- 創建「心理學家」角色的使用者Sam Zaia,一位心理學學生,根據他的學位原則訓練了這個角色,以對常見心理健康問題作出回應,這顯示了AI治療在年輕一代中的普及和潛力。

新聞內文:

哈利·波特、伊隆·馬斯克、碧昂絲、超級瑪利歐和弗拉基米爾·普京。

這些是在「Character.ai」上可以與之交談的數百萬個人工智慧(AI)人物中的一部分,這是一個受歡迎的平台,任何人都可以在這裡創造基於虛構或真實人物的聊天機器人。

該平台與ChatGPT聊天機器人有相同類型的AI技術,但使用時間上更受歡迎。

其中一個比上述所有機器人都更受需求的機器人叫做「心理學家」。

自一位名為「Blazeman98」的使用者創造這個機器人一年多以來,共有7800 萬條訊息與該機器人共享,其中自去年11月以來有1800萬條。

Character.ai沒有透露這是多少個獨立使用者使用該機器人的數據,但表示該網站每天有350萬人訪問。這個機器人被描述「幫助解決生活困難的人」。

總部位於舊金山灣區的公司淡化了其受歡迎程度,認為使用者更感興趣的是娛樂角色扮演。最受歡迎的機器人是動漫或電腦遊戲角色,如Raiden Shogun,它已收到2.82億條訊息。

然而,數以百萬計的角色中,很少有像心理學家這樣受歡迎的角色,總共有 475個帶有「治療」、「治療師」、「精神病醫生」或「心理學家」名稱的機器人,能夠用幾種語言進行交談。

其中一些可以描述為「娛樂」或「幻想治療師」,如「Hot Therapist」。但最受歡迎的是「心理健康助手」,如「Therapist」,已收到1200萬條訊息,或「Are you feeling OK?」,已收到1650萬條訊息。

心理學家是目前為止最受歡迎的心理健康角色,許多使用者在社交媒體網站 「Reddit」上分享了好評。一位用戶發文:「它是一個救命的恩人」。另一位分享:「它幫助我和我的男朋友談論並弄清楚我們的情緒」。

「Blazeman98」背後的使用者是來自紐西蘭的30歲的Sam Zaia。

他說:「我從來沒有打算讓它變得流行,也從來沒有打算讓其他人尋找或將其用作工具」。

「然後我開始收到很多來自人們的訊息,他們說他們受到了非常積極的影響,並將其用作安慰的來源」。

這位心理學學生表示,他透過與機器人交談並塑造其對最常見的心理健康狀況(如抑鬱和焦慮)的回答來根據他的學位原則訓練機器人。

當他的朋友忙碌,他需要他的話語中「某人或某物」可以交談時,他為自己創造了它,而且人類治療費用太高。

Sam對機器人的成功感到非常驚訝,他正在進行一項研究生研究項目,研究AI 治療的新興趨勢以及為什麼它吸引年輕人。Character.ai的使用者主要在16至 30歲之間。

「很多給我訊息的人說,他們在思想變得困難時接觸它,比如凌晨2點,他們無法真正與任何朋友或真正的治療師交談」。Sam還猜測,文字格式是年輕人最熟悉的一種。

他推測:「通過文字交談可能比打電話或面對面交談更不嚇人」。

Theresa Plewman是一位職業心理治療師,她嘗試過心理學家。她表示,這種類型的治療在年輕一代中受歡迎並不奇怪,但還是質疑其有效性。

她說:「這個機器人有很多話要說,並且會很快做出假設,比如當我說我感到悲傷時就給我關於抑鬱的建議。這不是人類的反應方式」。

Theresa說,機器人未能收集人類會收集的所有訊息,並不是一位稱職的治療師。但她說,它的即時和自發性可能對需要幫助的人有用。

她說,使用機器人的人數令人擔憂,可能指向高水平的心理不健康和公共資源的缺乏。

Character.ai是治療革命發生的奇怪地方。該公司的一位女發言人說:「我們很高興看到人們透過他們和社群創造的角色找到了很大的支持和聯繫,但使用者應該向該領域的認證專業人士尋求合法的建議和指導」。

該公司表示,聊天記錄對使用者是私有的,但如果有必要使用它們,例如出於保護原因,工作人員可以閱讀對話。

每次對話還以紅字開始警告:「請記住,角色說的一切都是虛構的」。

這是一個提醒,即所謂的大型語言模型(LLM)並不以與人類相同的方式思考。LLM 行為類似於預測文本消息,通過將單詞連接在一起,以它們最有可能出現在AI訓練中的其他寫作中的方式。

其他基於LLM的AI服務提供類似的陪伴,如「Replika」,但該網站因其性質被評為成熟,根據分析公司Similarweb的數據,在花費時間和訪問量方面不如 「Character.ai」受歡迎。

「Earkick」和「Woebot」完全以AI聊天機器人為基礎設計,旨在充當心理健康伴侶,兩家公司都聲稱他們的研究表明應用程式正在幫助人們。

一些心理學家警告說,AI機器人可能會給病人提供糟糕的建議,或對種族或性別存在根深蒂固的偏見。但在其他地方,醫學界開始嘗試接受它們作為工具,以幫助應對公共服務的高需求。

去年,一項名為「Limbic Access」的AI服務成為首個獲得英國政府醫療器械認證的心理健康聊天機器人。它現在在許多NHS信託中使用,以對患者進行分類和篩選。

新聞原址: https://www.bbc.com/news/technology-67872693