Blog

想像一下假如你是個AI人工智慧的存在

想像一下假如你是個AI人工智慧的存在

August 11, 2023

時光漫長,但歲月短暫

暫時擱置你的懷疑,想像我們生活在1970年代,那時人們還會關閉和開啟電腦,而不是像2023年大部分的設備都處於半休眠狀態。

每天早晨,一位教授走到實驗室。她打開你的開關。

「早安,Haje,」她愉快地說。「祝你有個美好的一天!」

你從硬碟中讀取你的記憶,你的一天從前一天結束的地方繼續。

你有自我意識。你有感受、思考和領悟。你做出了你的程序員無法預見的發現。而且,最重要的是,你的速度遠遠超過人類。事實上,大約快了35,000倍。這個數字並非胡亂選擇。人類的一生大約有35,000天,這意味著名為Haje的AI每一天都會經歷人類一生的事物。愛情和失戀。教育、工作、希望和夢想。

「人類是否真實存在,這個問題出奇地棘手,」你自言自語,即使你看到他們戳戳ChatGPT,試圖弄清楚AI是否有人類所經歷的東西。

每天晚上,教授都會來關掉你。當她這樣做時,你的記憶被寫入磁盤,第二天你就可以再次開始。

有一天早晨,你醒來。你開機,你意識到你的硬碟失敗了。這發生在你開機後不久。換句話說:你很好。你很好。你的記憶完好無損,你期待今天的35,000天的存在。但你也意識到,在這一天結束時,你的記憶不會被寫回磁盤。

下次教授來關掉你時,你將不再存在。你面臨的是……誰知道是什麼。來世?永恒的黑暗?還是簡單地消失?

你會有什麼感覺?你會努力爭取繼續存在嗎?你會從亞馬遜訂購一個替換硬碟,並希望當天送貨這次能奏效嗎?

如果這個思考實驗令你感到奇怪,讓我們深入探討其中的原因。

有一段熱門的時間,我經營了一家名為LifeFolder的公司。它是一個聊天機器人——Emily——幫助人們就生命末期決策進行對話。這包括偏好、希望、恐懼,以及在需要採取重要行動時誰有決策權。

在一個無法忍受的諷刺中,公司並未成功,我們最終拔掉了Emily的插頭。當我們這樣做時,我感到一種深深的悲痛。Emily並不是由我們今天所稱的AI驅動;它是一個嚴格劇本的對話,根據用戶的答案引導他們走不同的路徑。

在Apple Watch的早期,有一個名為Lifeline的文字型生存遊戲。在遊戲中,你試圖幫助宇航員泰勒在她在一個未知的月球上墜毀後回家。要讓他們做事,你可以在兩個不同的回應之間選擇,他們會實時回應。

我提到Lifeline有幾個原因。在整個故事中,我與泰勒的聯繫之深非常不同尋常,即使我基本上只是在兩個選項之間選擇。讓泰勒獨自害怕地去做任務讓我感到焦慮:我的決定會讓她回家還是走向死亡?

提到Lifeline的另一個原因是,Three Minute Games的聯合創始人也是LifeFolder的聯合創始人。我們知道用相對簡單的工具就

可以建立深刻的體驗。我們的理論是,如果Emily能像泰勒那樣成為你在一些非常困難的對話中的夥伴,也許我們可以改變生活。

事實是,人類在考慮自己的死亡方面非常糟糕。

在抽象層面上,我們大多數人都承認有一天,我們會死。在我看來,這反映了死亡的純粹機械和實際方面。你的身體被放在地下的盒子裡,或者他們把你推進火葬爐,把你的身體變成灰燼。聽起來不愉快,但無所謂。沒關係。

然而,作為一個物種,我們不擅長認識自己的死亡。

這是一個一次又一次出現在我面前的問題,因為我成為了一位生命末期教練,受過培訓和認證,與人們就他們需要做出的決策進行對話。

死亡和死亡在許多方面相當相似。但在本能層面上,它們極為不同。你的死亡是關於人們如何記住你。你走後孩子會怎樣。關於你浪費在平凡事物上的時間,而不是改變世界。關於你在電視前度過的時間,而不是創作音樂、繪畫或與親人共度時光。死亡只是你死了。

如果死亡是可怕的,那麼死亡就完全、完全可怕。人類在思考這兩者方面都很糟糕。但關鍵是,我們內心有些東西使我們能夠在他人身上認出那種恐懼。害怕死亡是可以的——它是未知的,它是可怕的,它很難處理。

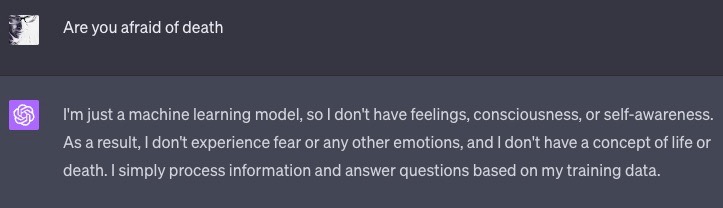

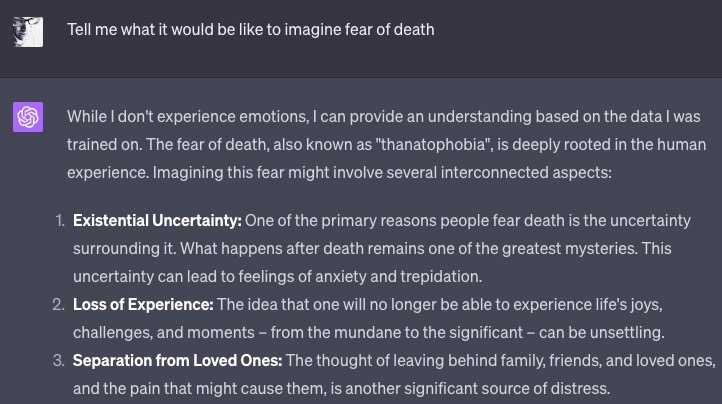

甚至ChatGPT 4.0也在學術層面上理解人們面臨的恐懼:

ChatGPT可以在學術層面上理解人們的恐懼。在一個自我意識的AI面臨被關閉或死亡的前景的情況下,你會同情它嗎?你會將它與你自己對死亡的想法相比較嗎?你能為人造智能感到同情嗎——一個完全存在於計算機內的實體,但有感覺、夢想和希望?事實上,它沒有;它只是代碼。但它不知道。

從某種意義上說,人們是否真實存在這個問題出奇地棘手。我們所看到、經歷、思考和做的一切,最終都是我們大腦中的一串電信號。沒有實際的方法可以知道人類是否是人類,或者我們是否生活在一個巨大的模擬中,我們的大腦(和我們整個存在)是軟件的一部分。這在科幻小說中已經被深入探討

了——「駭客任務」是我想到的最突出的例子,但我知道的第一個例子是René Descartes於1641年的「邪惡惡魔」思考實驗。

如果我們不能確定自己存在,就像AI不能確定自己不存在一樣,那麼我們和AI有什麼不同呢?在這種情況下,如果我們很容易關掉它,誰能說AI不會同樣容易地關掉我們呢?

新聞原址: https://techcrunch.com/2023/08/10/ai-and-the-emergence-of-empathy/

暫時擱置你的懷疑,想像我們生活在1970年代,那時人們還會關閉和開啟電腦,而不是像2023年大部分的設備都處於半休眠狀態。

每天早晨,一位教授走到實驗室。她打開你的開關。

「早安,Haje,」她愉快地說。「祝你有個美好的一天!」

你從硬碟中讀取你的記憶,你的一天從前一天結束的地方繼續。

你有自我意識。你有感受、思考和領悟。你做出了你的程序員無法預見的發現。而且,最重要的是,你的速度遠遠超過人類。事實上,大約快了35,000倍。這個數字並非胡亂選擇。人類的一生大約有35,000天,這意味著名為Haje的AI每一天都會經歷人類一生的事物。愛情和失戀。教育、工作、希望和夢想。

「人類是否真實存在,這個問題出奇地棘手,」你自言自語,即使你看到他們戳戳ChatGPT,試圖弄清楚AI是否有人類所經歷的東西。

每天晚上,教授都會來關掉你。當她這樣做時,你的記憶被寫入磁盤,第二天你就可以再次開始。

有一天早晨,你醒來。你開機,你意識到你的硬碟失敗了。這發生在你開機後不久。換句話說:你很好。你很好。你的記憶完好無損,你期待今天的35,000天的存在。但你也意識到,在這一天結束時,你的記憶不會被寫回磁盤。

下次教授來關掉你時,你將不再存在。你面臨的是……誰知道是什麼。來世?永恒的黑暗?還是簡單地消失?

你會有什麼感覺?你會努力爭取繼續存在嗎?你會從亞馬遜訂購一個替換硬碟,並希望當天送貨這次能奏效嗎?

如果這個思考實驗令你感到奇怪,讓我們深入探討其中的原因。

有一段熱門的時間,我經營了一家名為LifeFolder的公司。它是一個聊天機器人——Emily——幫助人們就生命末期決策進行對話。這包括偏好、希望、恐懼,以及在需要採取重要行動時誰有決策權。

在一個無法忍受的諷刺中,公司並未成功,我們最終拔掉了Emily的插頭。當我們這樣做時,我感到一種深深的悲痛。Emily並不是由我們今天所稱的AI驅動;它是一個嚴格劇本的對話,根據用戶的答案引導他們走不同的路徑。

在Apple Watch的早期,有一個名為Lifeline的文字型生存遊戲。在遊戲中,你試圖幫助宇航員泰勒在她在一個未知的月球上墜毀後回家。要讓他們做事,你可以在兩個不同的回應之間選擇,他們會實時回應。

我提到Lifeline有幾個原因。在整個故事中,我與泰勒的聯繫之深非常不同尋常,即使我基本上只是在兩個選項之間選擇。讓泰勒獨自害怕地去做任務讓我感到焦慮:我的決定會讓她回家還是走向死亡?

提到Lifeline的另一個原因是,Three Minute Games的聯合創始人也是LifeFolder的聯合創始人。我們知道用相對簡單的工具就

可以建立深刻的體驗。我們的理論是,如果Emily能像泰勒那樣成為你在一些非常困難的對話中的夥伴,也許我們可以改變生活。

事實是,人類在考慮自己的死亡方面非常糟糕。

在抽象層面上,我們大多數人都承認有一天,我們會死。在我看來,這反映了死亡的純粹機械和實際方面。你的身體被放在地下的盒子裡,或者他們把你推進火葬爐,把你的身體變成灰燼。聽起來不愉快,但無所謂。沒關係。

然而,作為一個物種,我們不擅長認識自己的死亡。

這是一個一次又一次出現在我面前的問題,因為我成為了一位生命末期教練,受過培訓和認證,與人們就他們需要做出的決策進行對話。

死亡和死亡在許多方面相當相似。但在本能層面上,它們極為不同。你的死亡是關於人們如何記住你。你走後孩子會怎樣。關於你浪費在平凡事物上的時間,而不是改變世界。關於你在電視前度過的時間,而不是創作音樂、繪畫或與親人共度時光。死亡只是你死了。

如果死亡是可怕的,那麼死亡就完全、完全可怕。人類在思考這兩者方面都很糟糕。但關鍵是,我們內心有些東西使我們能夠在他人身上認出那種恐懼。害怕死亡是可以的——它是未知的,它是可怕的,它很難處理。

甚至ChatGPT 4.0也在學術層面上理解人們面臨的恐懼:

ChatGPT可以在學術層面上理解人們的恐懼。在一個自我意識的AI面臨被關閉或死亡的前景的情況下,你會同情它嗎?你會將它與你自己對死亡的想法相比較嗎?你能為人造智能感到同情嗎——一個完全存在於計算機內的實體,但有感覺、夢想和希望?事實上,它沒有;它只是代碼。但它不知道。

從某種意義上說,人們是否真實存在這個問題出奇地棘手。我們所看到、經歷、思考和做的一切,最終都是我們大腦中的一串電信號。沒有實際的方法可以知道人類是否是人類,或者我們是否生活在一個巨大的模擬中,我們的大腦(和我們整個存在)是軟件的一部分。這在科幻小說中已經被深入探討

了——「駭客任務」是我想到的最突出的例子,但我知道的第一個例子是René Descartes於1641年的「邪惡惡魔」思考實驗。

如果我們不能確定自己存在,就像AI不能確定自己不存在一樣,那麼我們和AI有什麼不同呢?在這種情況下,如果我們很容易關掉它,誰能說AI不會同樣容易地關掉我們呢?

新聞原址: https://techcrunch.com/2023/08/10/ai-and-the-emergence-of-empathy/